엔비디아(www.nvidia.co.kr)가 3가지 컴퓨터 시스템(three computers)을 통해 차세대 AI 기술로 불리는 ‘ 물리적AI’ 구축을 지원한다. 이를 통해 엔비디아(NVIDIA)는 로보틱스 생태계 강화에 나선다고 밝혔다.

챗GPT(ChatGPT)는 생성형 AI의 탄생을 알리는 계기가 됐다. 이 기술은 거의 모든 질문에 대한 답변을 생성할 수 있어 콘텐츠 제작,고객 서비스, 소프트웨어 개발, 지식 근로자를 위한 비즈니스 운영 등 디지털 업무를 혁신하는 데 도움이 되고 있다.

그러나 휴머노이드, 공장,기타 산업 시스템 내 장치 등에서 인공 지능을 구현하는 물리적 AI는 아직 획기적인 전환점을 경험하지 못했다.

이로 인해 교통, 모빌리티, 제조, 물류, 로보틱스와 같은 산업들이 제약을 받아왔다. 하지만 고급 훈련, 시뮬레이션, 추론을 결합한3 가지 컴퓨터 시스템 덕분에 이러한 상황이 곧 변화를 맞이할 예정이다.

멀티모달 의 부상, 물리적 AI

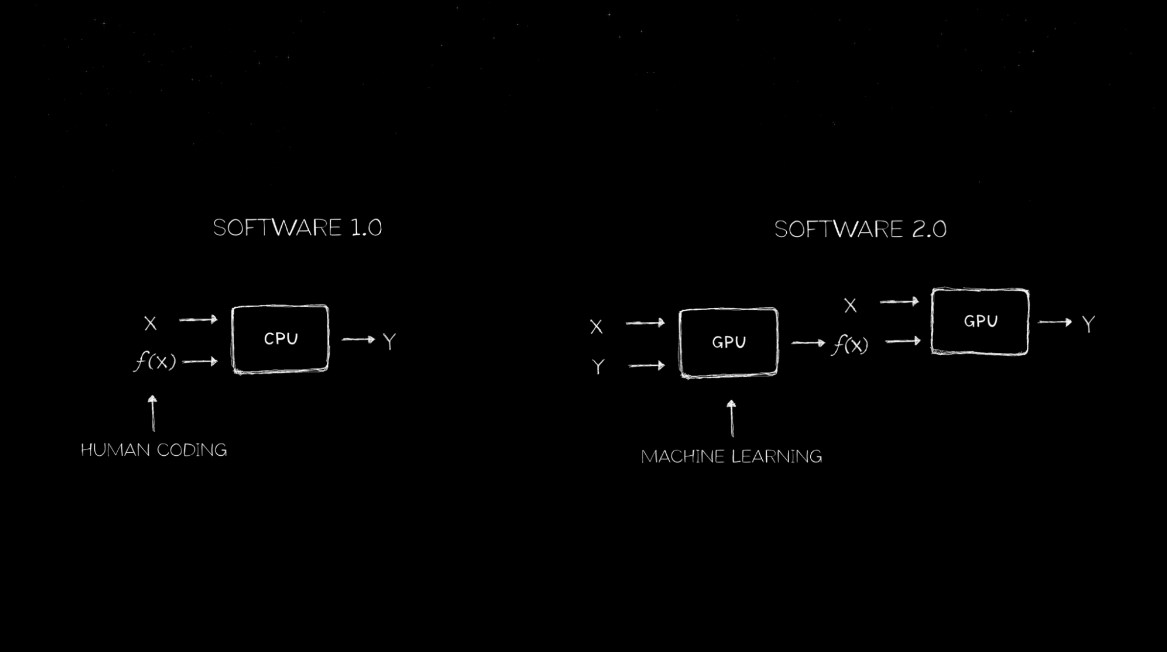

60년 동안 인간 프로그래머가 작성한 시리얼 코드인 ‘소프트웨어1.0(Software 1.0)’은 CPU로 구동되는 범용 컴퓨터에서 실행됐다.

그러다 2012년, 일리야 수츠케버(Ilya Sutskever)와 제프리 힌튼(Geoffrey Hinton)의 멘토링을 받은 알렉스 크리제브스키(Alex Krizhevsky)가 이미지 분류를 위한 혁신적인 딥러닝 모델인 알렉스넷(AlexNet)으로 이미지넷(ImageNet)의 컴퓨터 이미지 인식 대회에서 우승을 차지했다.

이로써 산업이AI를 최초로 접하게 됐고, GPU에서 실행되는 신경망인 머신 러닝의 획기적인 발전은 소프트웨어2.0의 시대를 열었다.

오늘날, 소프트웨어가 소프트웨어를 작성하고 있다. 전 세계의 컴퓨팅 워크로드는 CPU의 범용 컴퓨팅에서 GPU의 가속 컴퓨팅으로 이동하고 있으며, 이제 무어의 법칙은 한참 뒤처져 있다.

생성형 AI를 통해 멀티모달 트랜스포머와 확산 모델이 응답을 생성하도록 훈련을 받았다.

거대 언어 모델(Large Language Model, LLM)은 문자나 단어와 같은 모드에서 다음 토큰을 예측할 수 있는 1차원적인 모델이다. 이미지와 비디오 생성 모델은 다음 픽셀을 예측할 수 있는 2차원 모델이다.

하지만 이러한 모델들은 3차원 세계를 이해하거나 해석할 수 없다. 바로 여기에서 물리적 AI의 필요성이 대두된다.

물리적 AI모델은 생성형AI를 통해 물리적 세계를 인식하고, 이해하고, 상호 작용하고, 탐색할 수 있다. 가속 컴퓨팅을 기반으로 한 멀티모달 물리적A I의 혁신과 대규모 물리 기반 시뮬레이션을 통해 전 세계는 로봇을 활용한 물리적 AI의 가치를 실현할 수 있게 됐다.

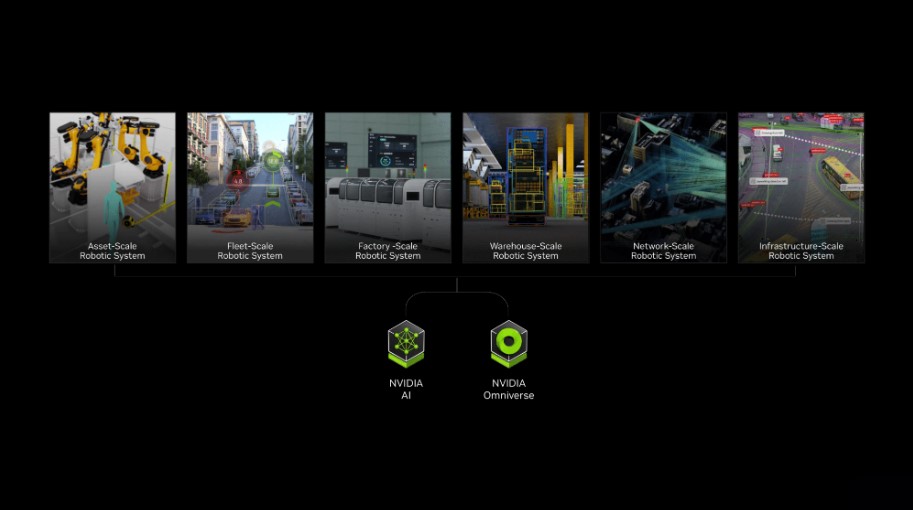

로봇은 지각, 추론, 계획, 행동, 학습을 할 수 있는 시스템이다. 로봇은 흔히 자율 주행 로봇(autonomous mobile robot, AMR),조작기 팔 또는 휴머노이드로 생각되지만, 이외에도 다양한 유형의 로봇이 존재한다.

가까운 미래에는 움직이는 모든 것, 또는 움직이는 사물을 모니터링하는 모든 것이 자율 로봇 시스템이 될 것이다. 이러한 시스템은 주변 환경을 감지하고 이에 대응할 수 있는 능력을 갖추게 된다.

수술실부터 데이터 센터, 창고, 공장,심지어 교통 관제 시스템이나 스마트 시티 전체에 이르기까지 모든 것이 정적인 수동 운영 시스템에서 물리적 AI로 구현된 자율적이고 상호 작용하는 시스템으로 변화할 것이다.

차세대 개척지:휴머노이드 로봇

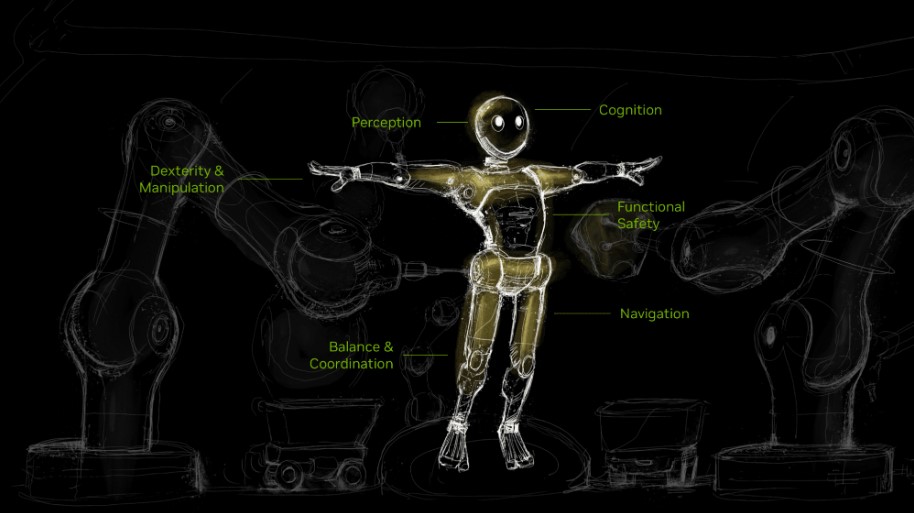

휴머노이드로봇은 인간을 위해 설계된 환경에서 효율적으로 작동할 수 있기 때문에 이상적인 범용 로봇이다. 이들은 배치와 작동을 위한 최소한의 조정만이 필요하다.

골드만삭스(Goldman Sachs)에 따르면휴머노이드 로봇의 글로벌 시장은 2035년까지3 80억 달러에 달할 것으로 예상되며, 이는 거의 2년 전에 예측한 약60억 달러에서 6배 이상 증가한 수치다.

전 세계의 연구진과 개발자들이 이 차세대 로봇을 개발하기 위해 경쟁하고 있다.

물리적 AI 개발을 위한3 가지 컴퓨터 시스템

휴머노이드 로봇을 개발하려면 물리적 AI와 로봇 훈련, 시뮬레이션, 런타임을 처리하는 3가지 가속화된 컴퓨터 시스템이 필요하다. 멀티모달 기반 모델과 로봇을 비롯한 그 세계의 확장 가능한 물리 기반 시뮬레이션이라는 두 가지 컴퓨팅 발전이 휴머노이드 로봇 개발을 가속화하고 있다.

생성형AI의 획기적인 발전으로 로봇에 3D인식, 제어, 기술 계획, 지능이 도입되고 있다. 개발자는 대규모 로봇 시뮬레이션을 통해 물리 법칙을 모방한 가상 세계에서 로봇 기술을 개선하고, 테스트하며 최적화할 수 있다. 이는 실제 데이터 수집 비용을 절감하고,안전하고 통제된 환경에서 로봇이 성능을 발휘할 수 있도록 돕는다.

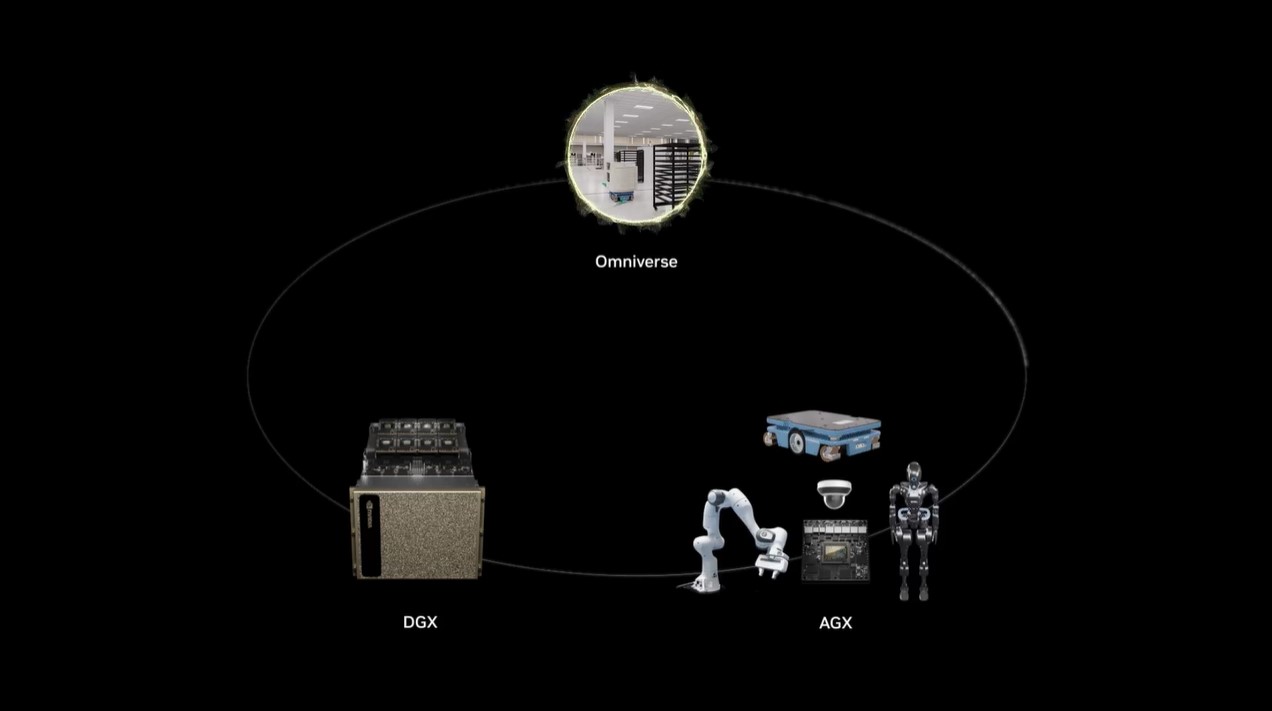

엔비디아는 개발자가 물리적 AI를 제작할 수 있도록 3가지 컴퓨터 시스템과 가속화된 개발 플랫폼을 구축했다.

먼저 슈퍼컴퓨터에서 모델을 훈련한다. 개발자는엔비디아 DGX플랫폼에서 엔비디아 네모(NeMo)를 사용해 강력한 파운데이션 모델과 생성형 AI 모델을 훈련하고 미세 조정할 수 있다. 또한 자연어를 이해하고 인간의 행동을 관찰해 움직임을 모방할 수 있는 휴머노이드 로봇을 위한 범용 파운데이션 모델을 개발하는 이니셔티브인 엔비디아 프로젝트GR00T(Project GR00T)를 활용할 수도 있다.

둘째, 엔비디아 OVX서버에서 실행되는엔비디아 옴니버스(Omniverse)는 물리적 AI를 테스트하고 최적화하기 위한 개발 플랫폼과 시뮬레이션 환경을 제공한다. 이는엔비디아 아이작 심(Isaac Sim)과 같은 애플리케이션 프로그래밍 인터페이스와 프레임워크를 통해 활용된다.

개발자들은 아이작 심을 사용해 로봇 모델을 시뮬레이션하고 검증하거나, 물리 기반 합성 데이터를 대량 생성해 로봇 모델 훈련을 진행할 수 있다. 또한 연구원과 개발자는 로봇강화 학습과 모방 학습을 지원하는 오픈 소스로봇 학습프 레임워크인 엔비디아 아이작 랩(Isaac Lab)을 사용해 로봇 정책 훈련과 개선을 가속화할 수 있다.

마지막으로 훈련된 AI 모델이 실행 컴퓨터에 배포된다. 엔비디아 젯슨 토르(Jetson Thor) 로봇 컴퓨터는 콤팩트한 온보드 컴퓨팅 요구 사항을 위해 특별히 설계됐다 .제어 정책, 비전, 언어 모델로 구성된 모델 집합이 로봇 두뇌를 구성하고, 에너지 효율적인 온보드엣지 컴퓨팅시스템에 배포된다.

로봇 제조업체와 파운데이션 모델 개발자는 워크플로우와 도전 과제에 따라 필요한 만큼의 가속 컴퓨팅 플랫폼과 시스템을 사용할 수 있다..

차세대 자율 시설 구축

로봇 시설은 이러한 모든 기술이 집약된 결과물이다.

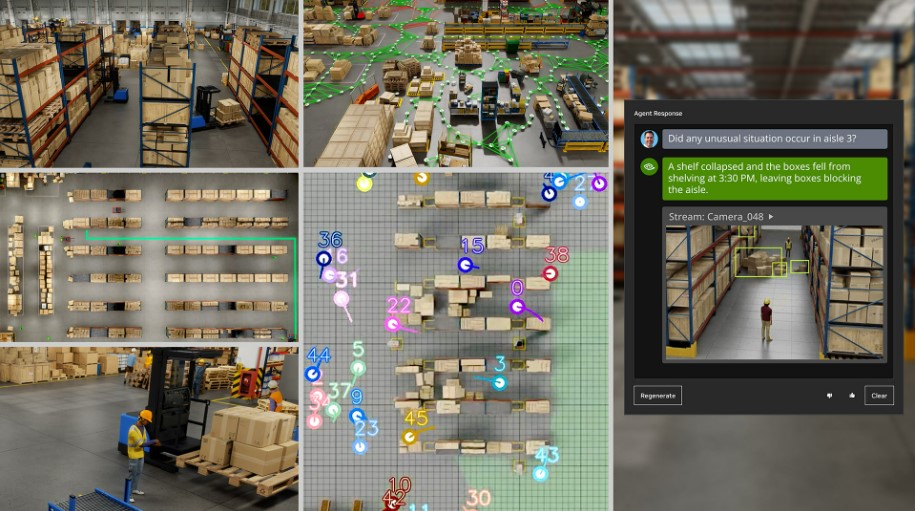

폭스콘(Foxconn)과 같은 제조업체나 아마존 로보틱스(Amazon Robotics)와 같은 물류 회사는 자율 로봇 팀을 구성해 인간 근로자와 함께 작업하고 수백 또는 수천 개의 센서를 통해 공장 운영을 모니터링할 수 있다.

이러한 자율 물류창고, 공장, 시설 등에는디지털 트윈이 도입될 것이다. 디지털 트윈은 레이아웃 계획과 최적화,운영 시뮬레이션 그리고 가장 중요한 로봇 플릿 소프트웨어 인 더 루프(software-in-the-loop) 테스트에 사용된다.

옴니버스 기반으로 구축된 ‘메가(Mega)’는 공장 디지털 트윈의 청사진으로, 산업 기업들이 로봇 플릿을 실제 공장에 배치하기 전에 시뮬레이션으로 테스트하고 최적화할 수 있도록 지원한다. 이는 무결점 통합, 최적의 성능, 최소한의 중단을 보장한다.

메가는 개발자들이 공장 디지털 트윈에 가상 로봇과 그 AI 모델, 즉 로봇의 두뇌를 배치할 수 있게 한다. 디지털 트윈의 로봇은 환경을 인식하고, 추론하고, 다음 동작을 계획한 후, 최종적으로 계획된 작업을 완료한다.

이러한 동작은 옴니버스의 월드 시뮬레이터를 통해 디지털 환경에서 시뮬레이션되고, 그 결과는 옴니버스의 센서 시뮬레이션을 통해 로봇의 두뇌에 전달된다.

센서 시뮬레이션을 통해 로봇의 두뇌는 다음 동작을 결정하고, 이 과정이 계속 반복된다. 메가는 공장 디지털 트윈 내의 모든 요소의 상태와 위치를 꼼꼼하게 추적한다.

이 고급 소프트웨어 인 더 루프 테스트 방법론을 통해 기업들은 옴니버스 디지털 트윈의 안전한 범위 내에서 변경 사항을 시뮬레이션하고 검증한다. 이로써 잠재적인 문제를 예측하고 완화해 실제 배포 시 위험과 비용을 줄일 수 있다.

개발자 생태계의 역량을 강화하는 엔비디아 기술

엔비디아는 3가지 컴퓨터 시스템을 통해 로봇 개발자와 로봇 파운데이션 모델 제작자로 구성된 글로벌 생태계의 작업을 가속화한다.

테라다인 로보틱스(Teradyne Robotics)의 자회사인 유니버설 로봇(Universal Robots)은 엔비디아 아이작 매니퓰레이터(Isaac Manipulator), 아이작 가속 라이브러리와 AI 모델, 엔비디아 젯슨 오린(Jetson Orin)을 사용해 UR AI 엑셀러레이터(UR AI Accelerator)를 구축했다.이는 코봇(cobot)개발자가 애플리케이션을 구축하고, 개발을 가속화하며, AI제품의 출시 기간을 단축할 수 있도록 돕는 즉시 사용 가능한 하드웨어와 소프트웨어 툴킷이다.

알고 로보틱스(RGo Robotics)는 엔비디아 아이작 퍼셉터(NVIDIA Isaac Perceptor)를 활용해 휠미(wheel.me) AMR이 언제 어디서나 작동하고, 인간과 유사한 지각과 시각 공간 정보를 통해 지능적인 의사 결정을 내릴 수 있도록 지원했다.

1X테크놀로지스(1X Technologies), 어질리티 로보틱스(Agility Robotics), 앱트로닉(Apptronik), 보스턴 다이내믹스(Boston Dynamics), 푸리에(Fourier), 갤봇(Galbot), 멘티(Mentee), 생츄어리AI(Sanctuary AI), 유니트리 로보틱스(Unitree Robotics), 샤오펑 로보틱스(XPENG Robotics) 등 휴머노이드 로봇 제조업체들이 엔비디아의 로봇 개발 플랫폼을 채택하고 있다.

보스턴 다이내믹스는 인간의 생산성을 높이고, 노동력 부족 문제를 해결하며,창고 내 안전을 우선시하는4족 보행 로봇과 휴머노이드 로봇을 제작하기 위해 아이작 심과 아이작 랩을 사용하고 있다.

푸리에는 과학 연구, 의료, 제조 등 높은 수준의 상호 작용과 적응력이 요구되는 분야에서 작동할 수 있는 휴머노이드 로봇을 훈련하기 위해 아이작 심을 활용하고 있다.

갤봇은 아이작 랩과 아이작 심을 사용해 다양하고 정교한 로봇 손에 적용할 수 있는 대규모 로봇 파지(grasp)데이터 세트인 덱스그랩스넷(DexGraspNet)과,정교한 파지 모델을 평가하기 위한 시뮬레이션 환경의 개발을 진전시켰다.

필드AI(Field AI)는 아이작 플랫폼과 아이작 랩을 활용해 로봇이 야외 환경에서 안전하게 작동할 수 있도록 위험 경계가 설정된 멀티태스킹, 다목적 파운데이션 모델을 개발했다.

이제 물리적AI의 시대가 도래했으며 이는 전 세계 중공업과 로보틱스를 혁신하고 있다.

여기에서 엔비디아 로보틱스에 대해 자세히 알아볼 수 있다..