엔비디아 옴니버스 클라우드

Ⅰ. 엔비디아 옴니버스 클라우드(NVIDIA Omniverse™ Cloud)

1. 개요

엔비디아옴니버스클라우드는 생성형 AI 지원 오픈USD(Open Universal Scene Description) 애플리케이션 개발을 위한 완전 관리형 서비스형 플랫폼(Platform-as-a-Service, PaaS)이다.

개발자와 엔터프라이즈(Enterprise)에 오픈USD와 RTX(Ray Tracing Texel eXtreme) 렌더링 기술 3D 산업 디지털화 애플리케이션에 쉽게 통합할 수 있도록 하는 풀 스택 클라우드 환경을 제공하며, 이 안에서 사용 가능한 서비스, API(Application Programming Interface, 애플리케이션 프로그래밍 인터페이스), SDK(Software Development Kit, 소프트웨어 개발 키트)를 지원한다.

엔비디아 OVX 서버에 배포되는 옴니버스 클라우드는 개발자가 맞춤형 워크플로우를 구축할 수 있도록 맞춤화가 가능한 샘플 애플리케이션과 프레임워크 제품군을 제공한다. 여기에는 3D 에셋 집계와 장면 조립, 디지털 트윈 개발, 합성 데이터 생성, 로보틱스 테스트와 시뮬레이션, 자율주행 자동차 훈련과 검증이 포함된다. 옴니버스 클라우드 서비스형 플랫폼에는 시스템 가동 중단 시간을 최소화하고 시스템 활용률과 사용자 생산성을 극대화하기 위한 엔비디아 전문가와 엔터프라이즈 지원에 대한 액세스가 포함된다.

2. 주요 이점

즉각적이고 안전한 액세스: 장소에 구애받지 않고 안전한 클라우드 서비스 인프라와 엔비디아 옴니버스 소프트웨어와 서비스에 빠르게 액세스할 수 있다.

단일 소스 서비스: 완전히 최적화된 인프라와 개발 플랫폼에 액세스해 가장 까다로운 3D와 디지털화 워크로드를 수용할 수 있다. 이 모든 서비스가 하나의 구독으로 제공된다.

설계를 통한 상호 운용성과 확장성: 엔터프라이즈 팀이 3D 워크플로우와 디지털 트윈을 위해 고급 오픈USD 기반 도구와 애플리케이션을 구축하도록 지원하는 진정한 PaaS 경험을 활용할 수 있다.

손쉬운 확장: 산업 디지털화 프로젝트가 성장함에 따라 사용자와 애플리케이션을 손쉽게 확장할 수 있다.

출처: https://www.nvidia.com/ko-kr/omniverse/cloud/

3. 제품군

옴니버스 클라우드 센서 RTX

⓵ 개요

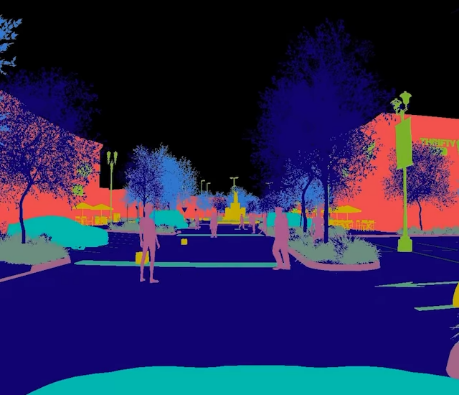

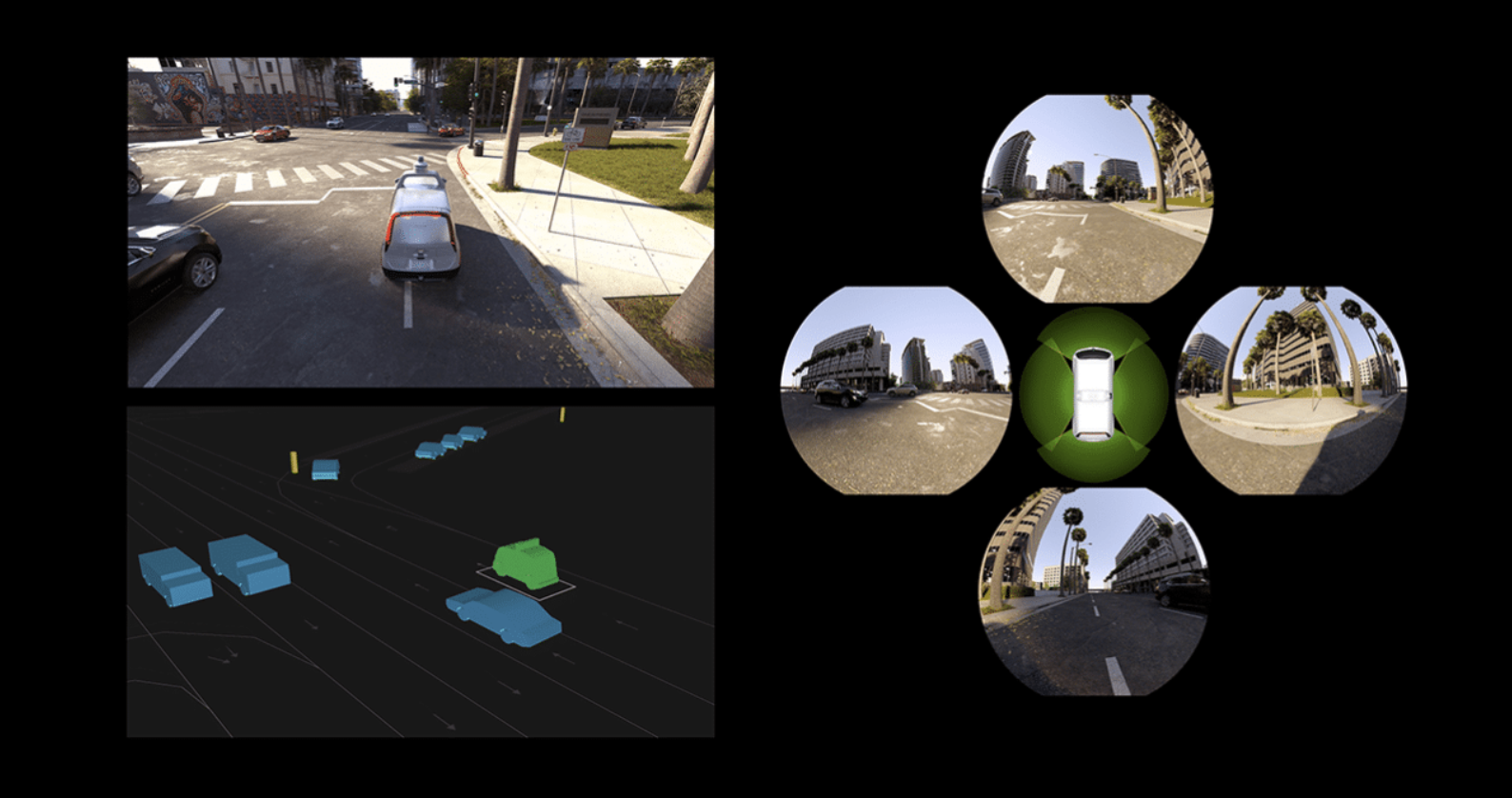

옴니버스 클라우드 센서 RTX는 물리적으로 정확한 센서 시뮬레이션을 통해 모든 종류의 완전 자율 머신 개발을 가속화할 수 있는 마이크로서비스 세트로, 개발자가 실제로 자율 머신을 배포하기 전에 물리적으로 정확하고 사실적인 가상 환경에서 센서 인식과 관련한 AI 소프트웨어를 대규모로 테스트할 수 있도록 지원한다.

엔비디아는 컴퓨터 비전과 패턴 인식(Computer Vision and Pattern Recognition, CVPR) 콘퍼런스의 대규모 엔드투엔드 주행을 위한 오토노머스 그랜드 챌린지에서 1위를 차지한 것과 동시에 옴니버스 클라우드 센서 RTX를 발표했다.

⓶ 사용 사례

실제 데이터가 제한적인 시나리오에서도 광범위한 활동의 시뮬레이션을 수행할 수 있다. 예를 들어 로봇 팔이 올바르게 작동하는지, 공항 수하물 컨베이어 벨트가 작동하는지, 나뭇가지가 도로를 막고 있는지, 공장 컨베이어 벨트가 움직이고 있는지, 로봇이나 사람이 근처에 있는지 등의 시뮬레이션이 가능하다.

자율주행 차량(AV) 시뮬레이션 개발자가 실제 환경에 AV를 도입하기 전에 물리적으로 정확한 환경에서 자율주행 시나리오를 테스트하는 것을 돕는다. 포어텔릭스(Foretellix)와 매스웍스(MathWorks)는 엔비디아가 AV 개발을 위해 옴니버스 클라우드 센서 RTX 액세스를 제공하는 최초의 소프트웨어 개발사 중 하나이다.

출처: https://blogs.nvidia.co.kr/blog/omniverse-microservices-physical-ai/

옴니버스 클라우드 API

(2) 옴니버스 클라우드 API

⓵ 개요

엔비디아는 올해 3월, ‘2024 GTC(Global Tech Conference)’에서 엔비디아 옴니버스 클라우드(NVIDIA Omniverse Cloud)가 API로 제공된다고 밝혔다. 이에 따라 소프트웨어 제조 생태계에 산업용 디지털 트윈 애플리케이션과 워크플로우 제작을 위한 플랫폼의 범위가 확장된다.

⓶ 종류

개발자는 다섯 개의 새로운 옴니버스 클라우드 API를 사용해 핵심 옴니버스 기술을 직접 쉽게 통합할 수 있다. 여기에는 디지털 트윈을 위한 기존 설계와 자동화 소프트웨어 애플리케이션, 로봇이나 자율 주행 차량과 같은 자율 머신의 테스트와 검증을 위한 시뮬레이션 워크플로우 등이 있다.

•USD 렌더(Render)는 오픈USD(OpenUSD) 데이터의 완전한 레이 트레이싱 RTX 렌더링을 생성한다.

•USD 라이트(Write)는 사용자가 오픈USD 데이터를 수정하고 상호 작용할 수 있다.

•USD 쿼리(Query)는 장면 쿼리와 인터랙티브 시나리오를 활성화한다.

•USD 노티파이(Notify)는 USD 변경 사항을 추적하고 업데이트를 제공한다.

•옴니버스 채널은 사용자, 도구, 세상을 연결해 여러 장면에서 협업할 수 있도록 지원한다.

옴니버스 클라우드 API

옴니버스 클라우드 API

⓷ 사용 사례

세계 최대 규모의 산업용 소프트웨어 제조업체들 중 일부는 소프트웨어 포트폴리오에 옴니버스 클라우드 API를 도입하고 있다.

•지멘스(Siemens)는 자동화, 디지털화, 지속 가능성을 위한 선도 기술업체이다. 지멘스는 업계 최고의 클라우드 기반 제품 수명주기 관리(PLM) 소프트웨어인 팀센터 X(Teamcenter X)와 지멘스 엑셀러레이터(Xcelerator) 플랫폼에 옴니버스 클라우드 API를 채택하고 있다. 옴니버스 API에 연결된 팀센터 X 소프트웨어는 설계 데이터를 엔비디아 생성형 AI API에 연결한 다음, 옴니버스 RTX 렌더링을 애플리케이션 내에서 직접 사용할 수 있다.

•엔지니어링 시뮬레이션 소프트웨어 선도업체인 앤시스(Ansys)도 옴니버스 클라우드 API를 채택했다. 자율 주행 차량용 앤시스 AV엑셀러레이트(Avxcelerate), 6G 시뮬레이션용 앤시스 퍼시브 EM(Perceive EM), 앤시스 플루언트(Fluent) 등의 엔비디아 가속 솔버에서 데이터 상호운용성과 RTX 시각화를 지원한다.

•선도적인 컴퓨팅 소프트웨어 제공업체인 케이던스(Cadence)는 기업이 데이터 센터를 물리적으로 구축하기 전에 디지털 트윈에서 먼저 설계, 시뮬레이션, 최적화할 수 있도록 자사의 케이던스 리얼리티(Reality) 디지털 트윈 플랫폼에 옴니버스 클라우드 API를 도입하고 있다.

•현실 기술 분야의 글로벌 선도업체인 헥사곤(Hexagon)은 USD 상호운용성을 통해 자사의 현실 캡처 센서와 디지털 현실 플랫폼을 엔비디아 옴니버스 클라우드 API와 통합할 예정이다. 이를 통해 고객에게 초현실적인 시뮬레이션과 시각화 기능을 제공하고자 한다.

•산업 자동화와 디지털 트랜스포메이션 기업인 로크웰 오토메이션(Rockwell Automation)은 옴니버스 클라우드 API를 사용해 RTX 지원 시각화를 강화할 계획이다.

•주요 자동차 공급업체인 콘티넨탈(Continental)은 공장 운영을 최적화하고 출시 기간을 단축하기 위해 디지털 트윈 플랫폼을 개발하고 있다.

출처: https://blogs.nvidia.co.kr/blog/omniverse-cloud-apis-industrial-digital-twin/

참고: https://www.nvidia.com/ko-kr/omniverse/digital-twins/siemens/

https://blogs.nvidia.co.kr/blog/siemens-immersive-visualization-generative-ai/

옴니버스 클라우드 API

옴니버스 클라우드 API

옴니버스 클라우드 API는 대규모의 고 충실도 센서 시뮬레이션으로 자율 시스템 개발을 가속화한다. 이는 자율 시스템이 겪게 될 수많은 실제 시나리오를 안전하게 탐색하기 위한 고충실도 센서 시뮬레이션에 대한 중요한 요구사항을 해결한다. 옴니버스 클라우드 API는 시뮬레이터, 검증 및 확인(V&V) 툴, 콘텐츠와 센서 개발자로 구성된 광범위한 에코시스템을 완성함으로써 AI 시스템 개발을 위한 범용 환경을 구현한다.

•칼라(CARLA)는 10만 명 이상의 개발자가 사용하는 오픈소스 AV 시뮬레이터다. 칼라 사용자는 옴니버스 클라우드 API를 통해 고충실도 센서 시뮬레이션으로 기존 워크플로우를 개선할 수 있다.

•마이터(MITRE)는 미 연방정부의 자금지원을 받는 R&D 센터를 운영하며 기술의 안전성 향상에 전념하는 비영리 단체이다. 마이터는 자율주행 솔루션 검증을 위해 AV 업계를 위한 디지털 시험장(Digital Proving Ground, DPG)을 구축하고 있다. DPG는 개발자를 위한 핵심 센서 시뮬레이션 기능을 구현하기 위해 옴니버스 API를 사용할 예정이다.

•매스웍스(MathWorks)와 포어텔릭스(Foretellix)는 테스트 시나리오의 작성, 실행, 모니터링, 디버깅을 위한 중요한 시뮬레이션 툴을 제공한다. GTC 데모에서 볼 수 있듯이 이러한 시뮬레이션, 테스트 자동화 툴과 API를 결합하면 AV 개발을 위한 강력한 테스트 환경을 구축할 수 있다.

•API를 복셀51(Voxel51)의 피프티원(FiftyOne) 플랫폼과 통합해 개발자는 시뮬레이션에서 생성된 실측 데이터를 쉽게 시각화하고 구성하며 훈련과 테스트를 간소화할 수 있다.

•선도적인 산업용 센서 솔루션 제공업체인 씨크 AG(SICK)는 센서 개발 프로세스에 이러한 API를 통합해 물리적 프로토타입 수를 줄인다. 또한 설계 수정을 빠르게 반복하며 최종 성능을 검증하기 위해 노력하고 있다. 이렇게 검증된 센서 모델은 최종적으로 자율 시스템 개발자가 애플리케이션에 사용할 수 있다.

출처: https://blogs.nvidia.co.kr/blog/omniverse-cloud-apis/

오픈 USD 기본 앱: https://www.nvidia.com/ko-kr/omniverse/foundation-apps/

오픈 USD 워크플로우: https://www.nvidia.com/ko-kr/omniverse/solutions/3d-design-collaboration/

디지털 트윈: https://www.nvidia.com/ko-kr/omniverse/solutions/digital-twins/

제조 분야 AI: https://www.nvidia.com/ko-kr/industries/manufacturing/

4. 최신 사용 사례

(1) 메트로폴리스와 NIM으로 대만 전자 대기업 산업 자동화 촉진

옴니버스 최신 사용 사례

옴니버스 최신 사용 사례

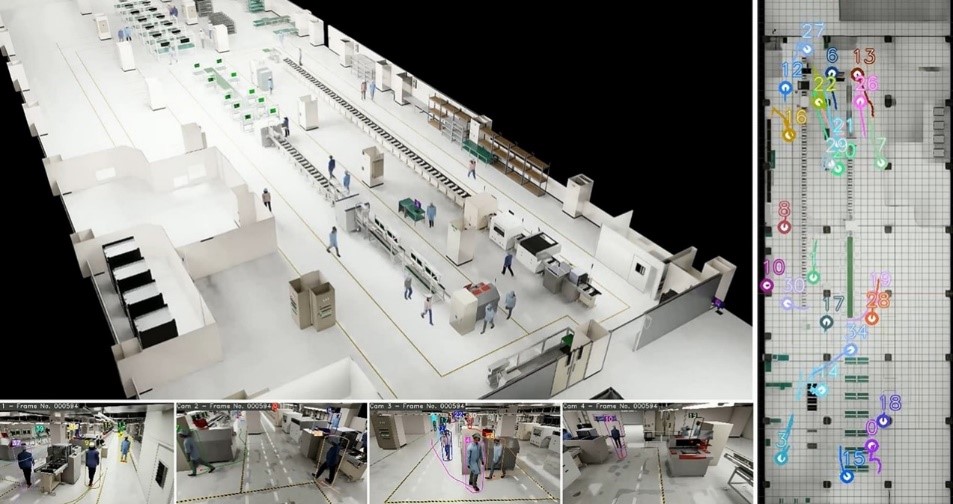

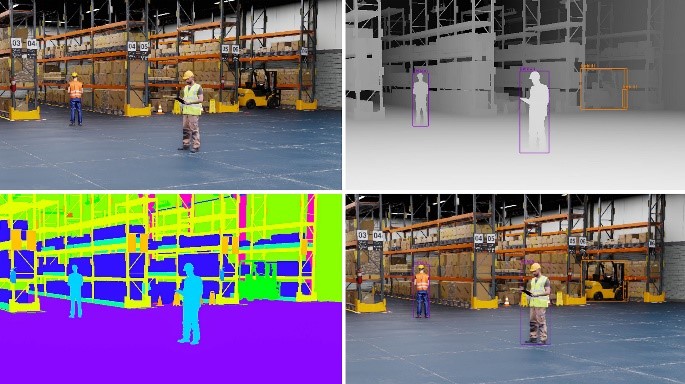

엔비디아 메트로폴리스와 엔비디아 NIM 마이크로서비스를 통해 대만 전자 대기업의 산업 자동화를 촉진하고 있다고 밝혔다. 대만의 주요 전자제품 대기업들은 대량의 로봇과 수백만 대의 카메라, 센서를 배치해 스마트 공장 전반의 효율성을 향상시키면서, AI를 활용한 제조 공정의 자동화로 나아가고 있다. 폭스콘(Foxconn), 페가트론(Pegatron), 위스트론(Wistron)을 비롯한 수십 여개의 전자제품 제조, 자동화 기업들이 타이베이에서 열린 컴퓨텍스(COMPUTEX) 2024에서 엔비디아(NVIDIA) 소프트웨어 사용법을 선보였다.

출처: https://blogs.nvidia.co.kr/blog/computex-metropolis-nim/

(2) AI와 옴니버스로 로봇 공장 산업 디지털화 가속화 지원

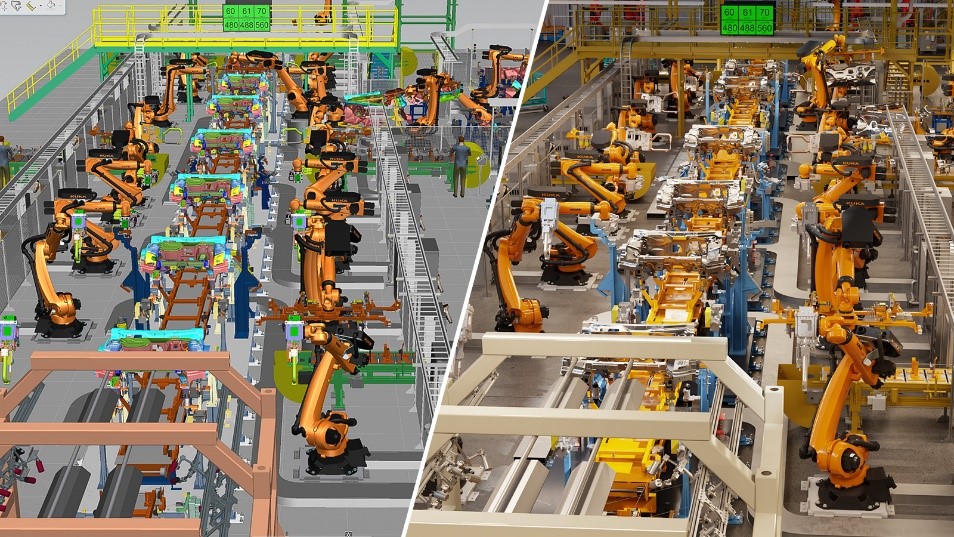

옴니버스 최신 사용 사례

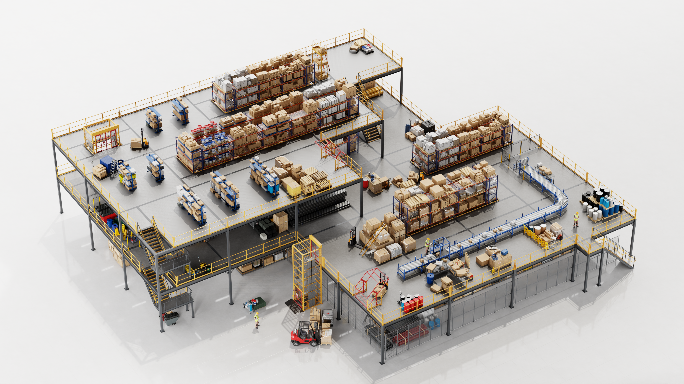

대만의 주요 전자 제조업체들은 엔비디아의 새로운 참조 워크플로우 기술을 통해 공장을 보다 자율적인 시설로 전환하고 있다고 발표했다. 해당 참조 워크플로우는 엔비디아 메트로폴리스(NVIDIA Metropolis) 비전 AI, 엔비디아 옴니버스(Omniverse) 물리 기반 렌더링 및 시뮬레이션, 엔비디아 아이작(Isaac™) AI 로봇 개발과 배포 기술들을 결합했다. 제조업체들은 이러한 워크플로우를 활용하여 실시간 공장 레이아웃 시뮬레이션을 위한 디지털 트윈을 구축할 수 있다. 이를 통해 비용이 크게 드는 실제 공장 변경 없이도 공간, 프로세스, 효율성을 최적화할 수 있다.

(3) 폭스콘에 AI 기술과 옴니버스로 공장 내 로봇 훈련과 조립 간소화 지원

옴니버스 최신 사용 사례

옴니버스 최신 사용 사례

세계 최대 전자제품 제조업체 폭스콘(Foxconn)이 엔비디아 옴니버스와 아이작 플랫폼 기반 디지털 트윈을 활용한다고 발표했다. 폭스콘은 전 세계에 170개 이상의 공장을 운영하고 있으며, 그중 가장 최신 공장은 최첨단 산업 자동화를 추진하는 가상 공장이다. 이는 멕시코 전자 산업의 중심지인 과달라하라(Guadalajara)에 구축한 새로운 공장의 디지털 트윈이다.

출처: https://blogs.nvidia.co.kr/blog/foxconn-digital-twin-ai/

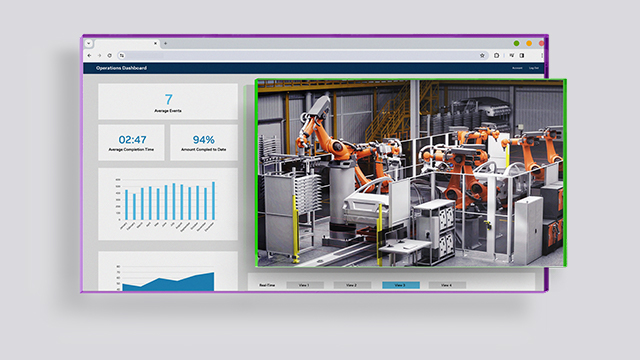

(4) 산업 자동화 위해 디지털 트윈과 실시간 AI 결합 소개

옴니버스 최신 사용 사례

옴니버스 최신 사용 사례

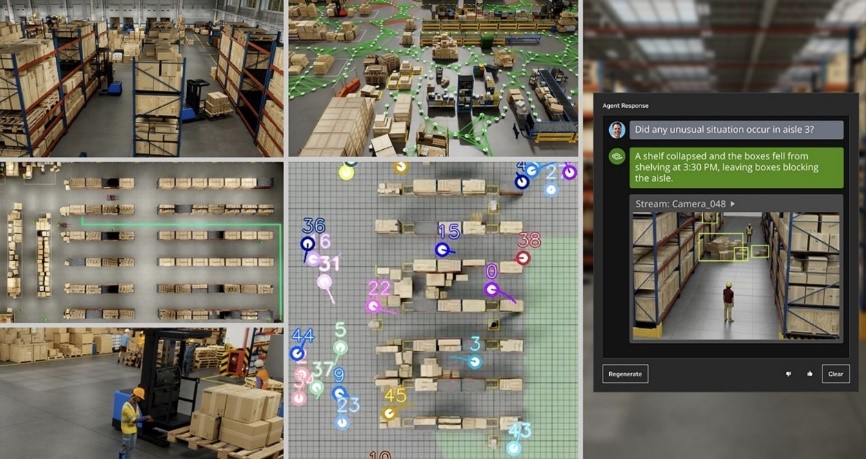

엔비디아 창립자 겸 CEO 젠슨 황(Jensen Huang)은 GTC 기조연설에서 개발자가 디지털 트윈(digital twin)을 사용해 대규모 실시간 AI를 산업 인프라에 적용하기 전, 이 전체를 먼저 시뮬레이션한 후 개발, 검증, 개선하면 상당한 시간과 비용을 절감해 산업 자동화에 큰 발전을 이룰 수 있다고 소개했다.

실시간(Real-Time) AI는 제조, 공장 물류, 로보틱스 분야의 중대한 작업을 처리하는 데 큰 도움을 주고 있다. 엔비디아 옴니버스, 메트로폴리스, 아이작과 cuOpt 플랫폼이 서로 상호작용하는 AI 훈련장(gym)에서, 개발자들은 인간과 로봇이 예측 불가능한 복잡한 상황을 탐색할 수 있도록 AI 에이전트(Agent)를 훈련시킬 수 있다.

디지털 트윈과 리얼타임 AI의 융합 데모 영상

https://youtu.be/JQdyzQdMRS0?si=5XFSriHKwODpCAtf

출처: https://blogs.nvidia.co.kr/blog/ai-digital-twins-industrial-automation-demo/

5. 관련 참고 자료

https://blogs.nvidia.co.kr/blog/virtual-factories-industrial-digitalization/

https://blogs.nvidia.co.kr/blog/auto-digitalization/

https://developer.nvidia.com/omniverse

오픈USD와 엔비디아 옴니버스의 최신 기술을 사용해 워크플로우를 혁신하는 방법에 초점을 맞춘 시리즈인 Into the Omniverse:

https://blogs.nvidia.co.kr/blog/synctwin-digital-twins-generative-ai-openusd/

https://blogs.nvidia.co.kr/blog/siemens-unlocks-future-of-manufacturing-with-openusd/

https://blogs.nvidia.co.kr/blog/openusd-advancements-gtc-developers/

엔비디아 아이작 플랫폼

엔비디아 아이작 플랫폼

Ⅱ 엔비디아 아이작(NVIDIA Isaac™) 플랫폼

1. 개요

엔비디아 아이작 플랫폼

엔비디아 아이작 플랫폼

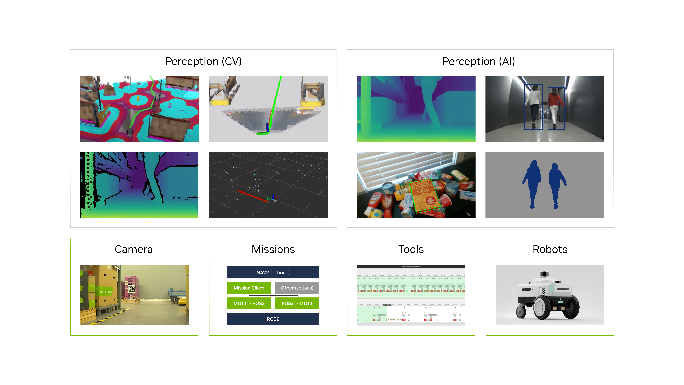

엔비디아 아이작은 자율 이동 로봇(AMR), 로봇 팔, 매니퓰레이터, 휴머노이드와 같은 AI 로봇의 개발을 가속화하는 엔비디아 가속 라이브러리, 애플리케이션 프레임워크, AI 모델로 구성된 AI 로봇 개발 플랫폼으로, 가속 컴퓨팅, 물리 기반 시뮬레이션과 생성형 AI의 최신 기술을 사용해 그 어느 때보다 더 정확하고 성능이 뛰어난 자율 머신을 빠르게 구축할 수 있도록 지원한다.

출처: https://developer.nvidia.com/isaac

2. 로보틱스AI

산업계 전반에서 운영 효율성을 개선하고, 인력 부족을 해결하며, 반복적인 작업을 최적화하고, 위험한 작업이나 환경을 관리하기 위한 솔루션을 모색함에 따라, 자율 머신과 AI 지원 로봇에 대한 수요가 사상 최고치를 기록하고 있다. AI, 가속 컴퓨팅, 물리 기반 시뮬레이션, 센서 등이 포함된 방대한 엔비디아의 로보틱스 AI 에코시스템을 통해 오늘날의 AI 로봇은 복잡한 작업에 쉽게 적응하고, 학습하며, 정밀하게 수행할 수 있다. 개발자는 엔비디아 로보틱스 풀 스택, 가속화된 클라우드-엣지 시스템, 가속화 라이브러리, 최적화된 AI 모델을 사용하여 로봇 시스템과 소프트웨어를 개발, 훈련, 시뮬레이션, 배포, 운영, 최적화하고 있다.

출처: https://www.nvidia.com/ko-kr/industries/

https://www.nvidia.com/ko-kr/industries/robotics/

3. 제품군

(1) 엔비디아 아이작 ROS(Robot Operating System)

엔비디아 아이작 ROS

엔비디아 아이작 ROS

엔비디아아이작ROS 는 ROS, 즉 로봇 운영 체제 커뮤니티 개발자와 로봇 공학자에게 엔비디아 가속 라이브러리, AI 모델을 제공하는 모듈식 ROS 2 패키지 모음이다. 컴퓨터 비전, 이미지 처리, 견고한 물체 인지, 충돌 감지, 궤적 최적화를 위한 다양한 패키지를 플러그 앤 플레이(Plug and Play, 프린터 같은 주변 기기를 컴퓨터 본체에 연결만 하면 바로 사용 가능)해 손쉽게 제작과 생산 단계로 전환할 수 있다. 모든 ROS 2 노드와 호환되므로 기존 애플리케이션에 쉽게 통합할 수 있고, 로봇 공학 전용 데이터 세트로 사전 학습된 모델과 엔비디아 AI를 사용해 로봇 애플리케이션 개발 시간을 획기적으로 단축할 수 있다.

출처: https://developer.nvidia.com/isaac/ros

(2) 엔비디아 아이작 퍼셉터(Perceptor)

엔비디아 아이작 퍼셉터

엔비디아 아이작 퍼셉터는 비정형 환경에서 인식, 위치 파악, 작동이 가능한 자율주행 로봇(Autonomous Mobile Robot, AMR)의 빠른 구축을 지원하는 아이작 ROS 기반 참조 워크플로우다. AI 기반 자율 이동 로봇에 멀티 카메라, 3D 서라운드 360도 비전 기능, AMR 설치를 위한 고급 인식 기능과 비전 AI를 제공한다. 이는 제조나 주문 처리 작업에 활용되는 자율이동 로봇에서 효율성과 작업자 안전성을 높이고 오류율과 비용을 절감하기 위해 점점 더 많이 사용되고 있는 기능이다. 이를 초기에 도입한 기업으로는 자재 취급 작업 등에서 새로운 수준의 자율성을 목표로 하는 아크베스트(ArcBest), BYD, 키온 그룹(KION Group) 등이 있다.

출처: https://developer.nvidia.com/isaac/perceptor

https://blogs.nvidia.co.kr/blog/isaac-generative-ai-manufacturing-logistics/

https://blogs.nvidia.co.kr/blog/foundation-model-isaac-robotics-platform/

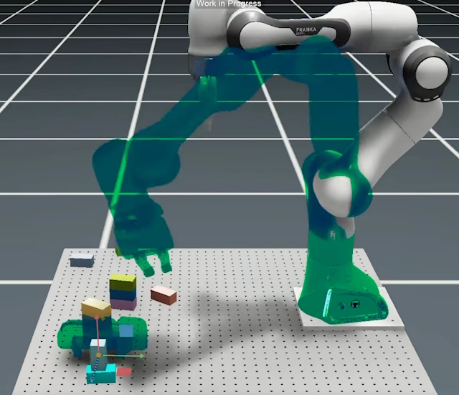

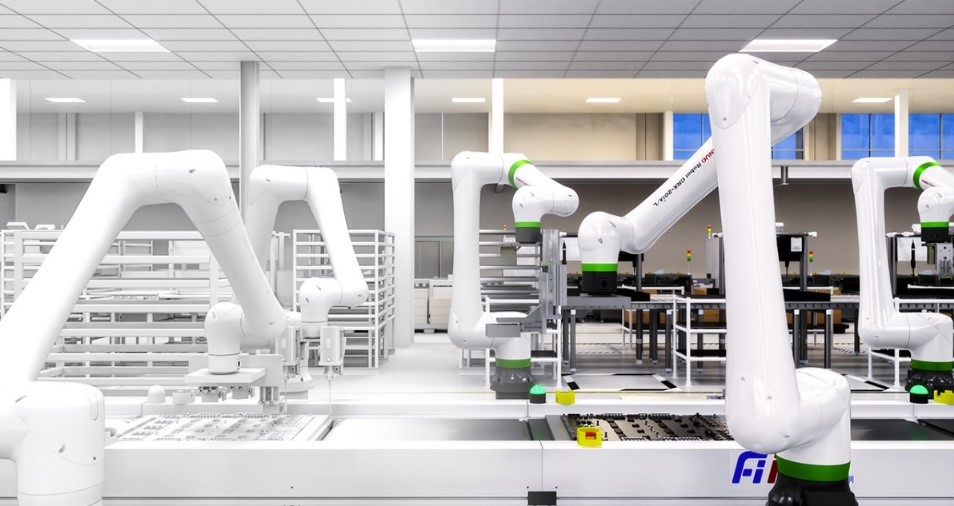

(3) 엔비디아 아이작 매니퓰레이터(Manipulator)

엔비디아 아이작 매니퓰레이터 .

엔비디아 아이작 매니퓰레이터는 아이작 ROS 기반의 참조 워크플로우로, AI 기반 로봇 팔(Robotic Arms)이나 매니퓰레이터 개발을 단순화해 주변 환경을 원활하게 인지하고, 이해하며, 상호 작용할 수 있게 한다. 로봇 팔을 위한 최첨단 모션 생성과 모듈식 AI 기능을 제공하며, 강력한 파운데이션 모델과 GPU 가속 라이브러리 컬렉션을 갖추고 있다.

아이작 매니퓰레이터를 고객에게 제공하기 위해 엔비디아와 협력하고 있는 대표적인 로봇 선도 기업으로는 야스카와(Yaskawa), 솔로몬(Solomon), 피크닉 로보틱스(PickNik Robotics), 레디 로보틱스(READY Robotics), 프랑카 로보틱스(Franka Robotics), 테라다인(Teradyne)의 자회사 유니버설 로봇(Universal Robots) 등이 있다.

출처: https://developer.nvidia.com/isaac/manipulator

https://blogs.nvidia.co.kr/blog/isaac-generative-ai-manufacturing-logistics/

https://blogs.nvidia.co.kr/blog/foundation-model-isaac-robotics-platform/

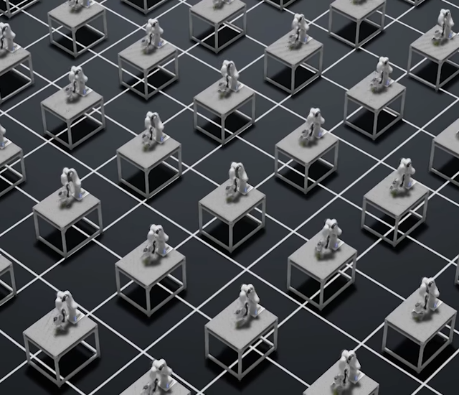

(4) 엔비디아 아이작 심(Sim)™

엔비디아 아이작 심

엔비디아 아이작 심

엔비디아 아이작 심은 엔비디아 옴니버스™ 플랫폼을 기반으로 물리 기반 환경에서 로봇과 자율 머신을 시뮬레이션, 테스트, 검증, 훈련하고 합성 데이터를 생성하기 위한 참조 애플리케이션이다. 엔비디아 옴니버스를 기반으로 구축된 엔비디아 아이작 심은 확장 가능하며 개발자가 자체 맞춤형 시뮬레이터를 구축하거나, 기존 테스트와 검증 파이프라인에 핵심 아이작 심 기술을 통합할 수 있다.

사실적인 시뮬레이션: 아이작 심은 옴니버스 플랫폼의 강력한 시뮬레이션 기술을 최대한 활용한다. 여기에는 엔비디아 피직스(PhysX)® 5를 통한 고급 GPU 지원 물리 시뮬레이션, 실시간 광선 및 경로 추적을 통한 포토리얼리즘, 물리 기반 렌더링을 위한 MDL 머티리얼 정의 지원이 포함된다.

다양한 애플리케이션을 위한 모듈식 아키텍처: 아이작 심은 훈련 데이터를 위한 조작, 탐색, 합성 데이터 생성 등 가장 일반적인 사용 사례를 처리할 수 있도록 제작됐다. 또한 모듈식 설계 덕분에 툴을 사용자 정의하고 새로운 사용 사례에 맞게 확장할 수 있다.

원활한 연결성과 상호 운용성: 아이작 심은 3D 및 시뮬레이션 툴 전반에 걸친 옴니버스 플랫폼의 OpenUSD 상호운용성을 활용하여 개발자가 로봇 모델과 가상 교육 환경을 쉽게 설계, 연결하고 공유할 수 있도록 지원한다.

출처: https://developer.nvidia.com/isaac/sim

(5) 엔비디아 아이작 랩(Lab)

엔비디아 아이작 랩

엔비디아 아이작 랩

엔비디아 아이작 랩은 AI 로봇 파운데이션 모델 훈련을 위한 강화, 모방, 전이 학습에 최적화된 아이작 시뮬레이션의 참조 애플리케이션이다. 아이작 심을 기반으로 구축된 경량 샘플 애플리케이션인 아이작 랩은 로봇 학습에 최적화되어 로봇 기초 모델 훈련에 핵심적인 역할을 하며, 휴머노이드용 프로젝트 GR00T 기초 모델을 비롯한 모든 유형의 로봇 구현을 훈련할 수 있다.

출처: https://developer.nvidia.com/isaac/sim

https://isaac-sim.github.io/IsaacLab/

4. 사용 사례

(1) 엔비디아아이작로보틱스, 수천만 대 AI 자율 머신 개발에 채택

아이작 최신 사용 사례

로봇 개발 분야의 세계적인 선도기업들이 차세대 인공지능 기반 자율 머신(autonomous machine)과 로봇의 연구, 개발, 생산을 위해 엔비디아 아이작 로보틱스 플랫폼을 도입하고 있다고 발표했다. BYD 일렉트로닉스(BYD Electronics, BYDE), 지멘스(Siemens), 테라다인 로보틱스(Teradyne Robotics), 알파벳(Alphabet)의 자회사 인트린직(Intrinsic)을 포함한 10여 개의 글로벌 로봇 산업 리더들은 엔비디아 아이작 가속 라이브러리, 물리 기반 시뮬레이션, AI 모델을 소프트웨어 프레임워크와 로봇 모델에 통합해 공장, 창고, 물류 센터의 효율성과 안전성을 높이고 반복적이거나 초정밀 작업을 위한 지능형 보조 역할을 맡기고 있다.

출처: https://blogs.nvidia.co.kr/blog/robotics-industry-development-ai-autonomous-machines/

(2) 엔비디아 차세대 로봇 파지 기술 실현… 알파벳 자회사 인트린직과 협력

아이작 최신 사용 사례

파지 기술은 로봇 공학에서 오랫동안 추구된 기술로, 지금까지는 프로그래밍하는 데 드는 많은 시간과 비용의 문제로 인해 확장하기가 어려웠다. 그 결과 지금까지 로봇은 반복적인 픽앤플레이스(pick-and-place) 조건을 원활하게 처리하는 데 어려움이 있었다. 그러나 시뮬레이션이 상황을 변화시키고 있다. 인트린직은 엔비디아 아이작 심과 함께 엔비디아 옴니버스 플랫폼에 합류했다. 이들은 판금과 흡입 그리퍼(gripper)의 컴퓨터 지원 설계 모델을 사용해 진공 그립을 위한 합성 데이터를 생성했다. 이를 통해 인트린직은 산업용 공작 기계의 선두 제조업체인 트럼프 머신 툴스(Trumpf Machine Tools)의 고객사를 위해 프로토타입을 제작할 수 있었다.

출처: https://blogs.nvidia.co.kr/blog/alphabet-intrinsic-robotics-isaac-manipulator/

(3) 엔비디아, 아이작 로보틱스 플랫폼으로 제조·물류 분야에 AI 도입 촉진

아이작 최신 사용 사례

아이작 최신 사용 사례

엔비디아는 GTC 2024에서 파운데이션 모델, 로보틱스 툴, GPU 가속 라이브러리 컬렉션인 아이작 매니퓰레이터와 아이작 퍼셉터를 발표했다. 엔비디아 아이작 로보틱스 플랫폼은 최신 생성형 AI와 고급 시뮬레이션 기술을 활용해 AI 기반 로보틱스를 가속화하고 있다. 로봇 학습을 위한 아이작 랩, 하이브리드 클라우드 워크플로우 오케스트레이션(hybrid-cloud workflow orchestration)을 위한 엔비디아 오스모(OSMO)를 포함한 엔비디아 아이작 로봇 플랫폼의 새로운 툴도 발표했다.

출처: https://blogs.nvidia.co.kr/blog/isaac-generative-ai-manufacturing-logistics/

관련 참고 자료

https://blogs.nvidia.co.kr/blog/what-is-robotics-simulation/

https://blogs.nvidia.co.kr/blog/generative-ai-robotics-isaac/

https://blogs.nvidia.co.kr/blog/isaac-jetson-robotics/

https://blogs.nvidia.co.kr/blog/isaac-sim-major-updates/

모든 업계를 위한 AI 솔루션 구축 방법 | NVIDIA E-Book