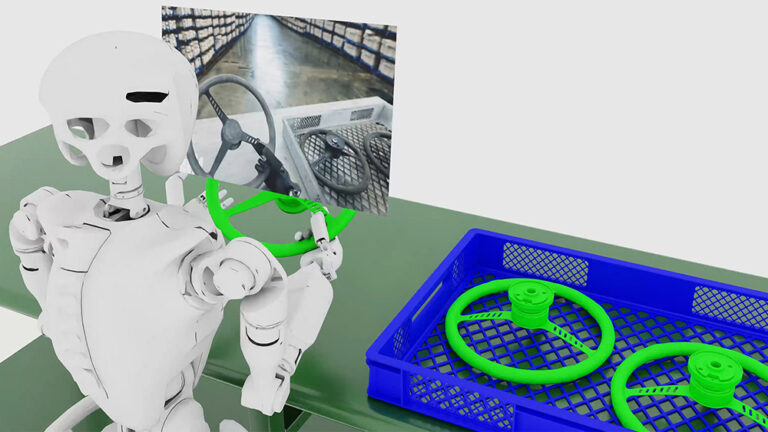

인간 작업자, 로봇 및 에이전트 시스템, 장비를 시설 디지털 트윈에 통합한다.(출처: Accenture, KION Group.)

엔비디아의 젠슨 황 최고경영자(CEO)는 미국 라스베이거스에서 열린 CES 2025에서Omniverse 업그레이드, Cosmos 파운데이션 모델 등을 공개했다.

여기에는 산업용로봇플릿디지털트윈 구축을 위한 메가옴니버스(Mega Omniverse) 청사진, 옴니버스(Omniverse)에 생성형 물리 AI 추가, 코스모스 월드 파운데이션 모델(Cosmos World Foundation Model) 플랫폼 출시, 아이작(Isaac) 플랫폼 업데이트 출시 등이 포함됐다.

이러한 발표는 NVIDIA가 로보틱스를위한인공지능기술, 특히 생성형 AI에 대한 투자를 어떻게 두 배로 늘리고 있는지 보여주었다. 캘리포니아주 산타클라라에 본사를 둔 이 회사는 신제품 외에도 도요타(Toyota), 오로라(Aurora), 콘티넨탈(Continental)이 엔비디아 컴퓨팅과 AI를 활용한 소비자 및 상용차를 개발하고 있다고 발표했다.

엔비디아는 또한 드라이브 하이페리온 플랫폼이 자동차 안전 및 사이버 보안에 중요한 이정표를 달성했다고 밝혔다. 이 플랫폼은 자동차 등급 안전 및 사이버 보안에 대한 두 업계 권위자인 TÜV SÜD와 TÜV Rheinland의 산업 안전 평가를 통과했다고 밝혔다.

엔비디아의 '엔드-투-엔드(end-to-end)' 시스템에는 DRIVE AGX 시스템온칩(SoC) 및 레퍼런스 보드 설계, 엔비디아 드라이브OS(DriveOS) 자동차 운영 체제, 센서 제품군, 액티브 세이프티 및 SAE 레벨 2+ 드라이빙 스택이 포함된.

NVIDIA, Omniverse 업데이트

NVIDIA는 실제 시설에 배포하기 전에 디지털 트윈에서 물리적 AI와 로봇 플릿을 대규모로 개발, 테스트, 최적화하기 위한 Omniverse 청사진인 Mega를 발표했다.

메가는 기업에 가속 컴퓨팅, AI, 엔비디아 아이작(NVIDIA Isaac), 엔비디아 옴니버스(NVIDIA Omniverse) 기술의 레퍼런스 아키텍처를 제공한다고 회사 측은 밝혔다. 이를 통해 로봇, 비디오 분석, AI 에이전트, 장비 등을 구동하는 AI 기반 "두뇌"를 테스트하기 위한 디지털 트윈을 개발하고 테스트할 수 있다.

엔비디아는 새로운 옴니버스(Omniverse) 프레임워크가 엄청난 복잡성과 규모를 처리할 수 있다고 덧붙였다. 소프트웨어 정의 기능을 물리적 시설에 도입하여 지속적인 개발, 테스트, 최적화 및 배포를 가능하게 할 수 있다고 회사는 주장했다.

엔비디아는 모든 로봇 활동과 센서 데이터를 조율하는 월드 시뮬레이터를 포함한 메가 기반 디지털 트윈을 통해 기업은 지능형 경로와 작업을 위해 로봇을 지속적으로 업데이트해 운영 효율성을 높일 수 있다고 밝혔다.

이 청사진은 Omniverse Cloud Sensor RTX 애플리케이션 프로그래밍 인터페이스(API)를 사용하며, 이를 통해 개발자는 충실도가 높은 대규모 센서 시뮬레이션을 위해 공장의 모든 유형의 지능형 기계에서 동시에 데이터를 렌더링할 수 있다. 이를 통해 NVIDIA Isaac ROS를 통해 HIL(Software-in-the-Loop) 파이프라인에서 합성 데이터를 사용하여 디지털 트윈 내의 무한한 시나리오에서 로봇을 테스트할 수 있다.

NVIDIA는 또한 NVIDIA Omniverse 통합을 로보틱스, 자율주행차(AV), 비전 AI와 같은 물리적 AI 애플리케이션으로 확장하기 위한 생성형 AI 모델과 청사진도 발표했다. 회사는 이러한 모델이 세계 구축, 물리적 속성으로 세계에 레이블 지정, 사실적으로 만드는 것을 포함하여 물리적 AI 시뮬레이션을 위한 3D 세계를 만드는 각 단계를 가속화한다고 말했다.

“물리적 AI는 50조 달러 규모의 제조 및 물류 산업에 혁명을 일으킬 것입니다. 자동차와 트럭에서 공장과 창고에 이르기까지 움직이는 모든 것은 로봇이 되고 AI로 구현될 것입니다. NVIDIA의 Omniverse 디지털 트윈 운영 체제와 코스모스 물리 AI는 전 세계 물리적 산업의 디지털화를 위한 기본 라이브러리 역할을 합니다"라고 젠슨 황은 말했다.

코스모스 세계 기반 모델은 물리적 AI 개발 가속화를 목표로 한다

1X, 애자일 로봇(Agile Robots), 어질리티(Agility), 피겨 AI(Figure AI), 포어텔릭스(Foretellix), 푸리에(Fourier), 갤보트(Galbot), 힐봇(Hillbot), 인트봇(IntBot), 뉴라 로보틱스(Neura Robotics), 스킬드 AI(Skild AI), 우버(Uber), 버추얼 인시전(Virtual Incision), 와비(Waabi), XPENG 등의 기업들이 코스모스를 최초로 채택했다.(출처: NVIDIA)

NVIDIA는 옴니버스(Omniverse) 업데이트 외에도 제너레이티브 월드 파운데이션 모델, 고급 토크나이저, 가드레일, AV 및 로봇과 같은 물리적 AI 시스템의 개발을 발전시키기 위해 구축된 가속 비디오 처리 파이프라인으로 구성된 플랫폼인 코스모스(Cosmos)도 출시했다.

이 회사는 물리적 AI 모델을 개발하는 데 비용이 많이 들고 방대한 양의 실제 데이터와 테스트가 필요하다고 주장했다. 코스모스 월드 파운데이션 모델(WFM)은 개발자에게 기존 모델을 훈련하고 평가하기 위해 방대한 양의 사실적인 물리 기반 합성 데이터를 생성할 수 있는 쉬운 방법을 제공한다. 개발자는 Cosmos WFM을 미세 조정하여 사용자 지정 모델을 구축할 수도 있다.

NVIDIA는 Cosmos의 개방형 모델 제품군을 통해 개발자가 AV 여행의 비디오 녹화 또는 창고를 탐색하는 로봇과 같은 데이터 세트로 대상 애플리케이션의 요구 사항에 따라 WFM을 사용자 지정할 수 있다고 언급했다.

이 회사는 물리적 AI 연구 및 개발을 위해 WFM을 설계했다고 밝혔다. WFM은 텍스트, 이미지, 비디오와 같은 입력 조합과 로봇 센서 또는 모션 데이터로부터 물리 기반 비디오를 생성할 수 있다.

“로보틱스를 위한 ChatGPT의 순간이 다가오고 있습니다. 대규모 언어 모델과 마찬가지로 월드 파운데이션 모델은 로봇 및 AV 개발을 발전시키는 데 기본이 되지만, 모든 개발자가 자체 교육을 할 수 있는 전문 지식과 리소스를 가지고 있는 것은 아닙니다. 우리는 물리적 AI를 대중화하고 모든 개발자가 일반 로봇 공학을 이용할 수 있도록 하기 위해 Cosmos를 만들었습니다”라고 젠슨 황은 말했다.

엔비디아는 코스모스 모델이 로보틱스, AI, 자율주행차 커뮤니티의 작업을 가속화하기 위해 오픈 모델 라이선스에 따라 제공될 것이라고 밝혔다. 개발자는 NVIDIA API 카탈로그에서 첫 번째 모델을 미리 보거나, NVIDIA NGC 카탈로그 또는 Hugging Face에서 모델 제품군과 미세 조정 프레임워크를 다운로드할 수 있다.

NVIDIA는 또한 Isaac을 수정했다

엔비디아 아이작(NVIDIA Isaac)은 AI 로봇 개발을 가속화할 수 있는 가속 라이브러리, 애플리케이션 프레임워크, AI 모델 플랫폼입니다. Isaac Sim, Isaac Lab, Isaac Manipulator 및 Isaac Perceptor의 네 가지 애플리케이션으로 구성되어 있다.

NVIDIA Isaac Sim은 NVIDIA Omniverse를 기반으로 구축된 참조 애플리케이션으로, 사용자가 물리 기반 가상 환경에서 AI 기반 로봇을 개발, 시뮬레이션 및 테스트할 수 있도록 지원합니다. Isaac Sim 4.5는 다음과 같은 여러 가지 중요한 변경 사항을 제공한다.

•참조 응용 프로그램 템플릿

•URDF(Unified Robot Description Format) 가져오기 및 설정 개선

•향상된 물리 시뮬레이션 및 모델링

•새로운 조인트 시각화 도구

•시뮬레이션 정확도 및 통계

NVIDIA Cosmos 세계 기반 모델

NVIDIA Isaac Lab은 로봇 정책을 훈련하기 위한 로봇 학습을 위한 오픈 소스 통합 프레임워크다. 아이작 랩(Isaac Lab)은 엔비디아 아이작 심(Isaac Sim)을 기반으로 구축되어 개발자와 연구원들이 강력한 인식 기반 시뮬레이션 훈련 정책을 통해 지능적이고 적응력이 뛰어난 로봇을 보다 효율적으로 구축할 수 있도록 지원한다. Isaac Lab의 업데이트된 버전에는 바둑판식 렌더링 및 기타 삶의 질 개선과 같은 성능 및 사용성 개선 사항이 포함되어 있다.

ROS 2를 기반으로 구축된 NVIDIA Isaac Manipulator는 NVIDIA CUDA 가속 라이브러리, AI 모델 및 참조 워크플로우의 모음이다. 이제 픽 앤 플레이스(pick-and-place) 및 오브젝트 팔로우링(object following)을 위한 새로운 엔드 투 엔드 참조 워크플로우가 포함되어 있어 사용자가 오브젝트 팔로우 및 픽 앤 플레이스(pick-and-place)를 포함한 기본적인 산업용 로봇 암 작업을 빠르게 시작할 수 있다.

마지막으로, ROS 2를 기반으로 구축된 NVIDIA Isaac Perceptor는 자율 모바일 로봇(AMR) 개발을 위한 라이브러리, 모델 및 참조 워크플로우 모음이다. 이를 통해 AMR은 창고나 공장과 같은 구조화되지 않은 환경을 인식, 현지화 및 운영할 수 있다.

엔비디아는 최신 업데이트가 동적 환경에서 AMR 환경 인식과 운영 효율성을 크게 개선했다고 밝혔다. 여기에는 새로운 엔드 투 엔드 SLAM(Visual Simultaneous Localization and Mapping) 참조 워크플로, 사람 감지 및 동적 장면 요소를 사용하여 3D 장면 재구성을 위해 여러 카메라로 nvblox를 실행하는 새로운 예제, 여러 RGB-D 카메라에서 Isaac Perceptor를 실행하여 향상된 D 장면 재구성이 포함된다.